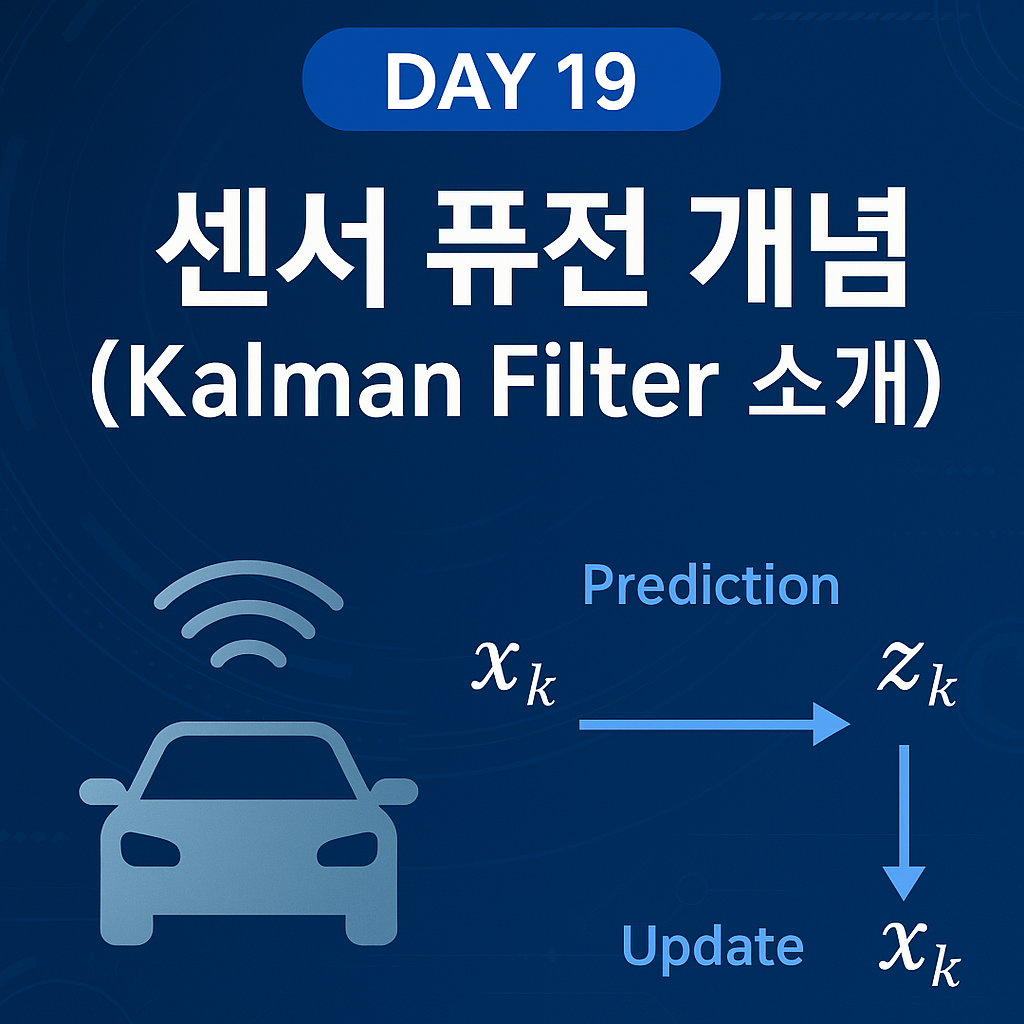

― 자율주행의 핵심, 위치 추정(Localization)의 완성 ―🌍 Localization이란 무엇인가?Localization(로컬라이제이션)은 자율주행차가“나는 지금 어디에 있는가?”를 스스로 인식하는 기술입니다.사람으로 비유하자면,GPS는 “지도 위 내 위치”,IMU는 “내가 어떻게 움직이고 있는지”,LiDAR는 “내 주변이 어떻게 생겼는지”를 알려주는 감각기관이에요.이 세 가지 센서를 융합하면차량은 단순히 위치를 아는 수준을 넘어,도로의 곡선, 경사, 장애물까지 인식하는 완벽한 위치 인식 능력을 가지게 됩니다.⚙️ 융합 Localization의 구조 이해Localization 시스템은 크게 3단계로 작동합니다.1️⃣ 센서 데이터 수집GPS: 차량의 절대 위치 좌표 (위도, 경도, 고도)IMU: ..